María Rosa Vallecillo Gámez.

Profesora Titular de Derecho del Trabajo y de la Seguridad Social.

Universidad de Jaén.

“No puedes tocar la libertad de mi mente”

John Milton

¿o si?

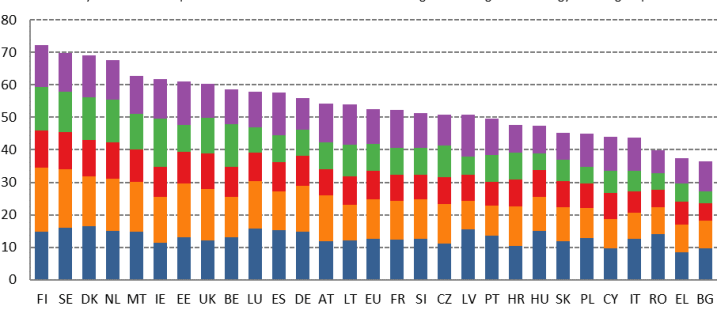

1.Tal y como ya avanzábamos en una entrada anterior, el gobierno de España ha lanzado el plan España Digital 2025 con la intención de que sea una de las palancas del crecimiento de la economía española, con una inversión pública y privada de unos 70 000 millones de euros y cofinanciación de Fondos Europeos destinados a la modernización de las administraciones públicas, la digitalización de las Pymes y la adquisición de competencias digitales entre otras. El establecimiento de la colaboración público-privada para poder llevar a cabo los proyectos parece haber despertado la conciencia de una necesaria seguridad jurídica que dote de confianza al sistema y permita que el empuje de los Fondos Europeos suponga un avance en la capacitación digital de pymes y ciudadanía y la atracción de la digitalización y el talento. Y eso porque la inseguridad jurídica ha sido, en ocasiones, causa de que las partidas presupuestarias destinadas a la inversión en proyectos de I+D+i, no se hayan ejecutado en su totalidad con el consiguiente retraso en el crecimiento económico y del empleo en nuestro país. A nadie cabe duda a estas alturas que enfrentar una transformación digital que se base en procesos transparentes, rigurosos, bien definidos y no discriminatorios que promuevan la innovación y el crecimiento, es fundamental para situar España en el grupo de países que lideran la transformación digital en Europa porque según el índice DESI (Digital Economy and Society Index), actualmente nos encontramos en el puesto 11 de los 28.

Fuente: DESI 2020, European Commission.

2.Las razones de la seguridad jurídica. Apostar por la seguridad jurídica ante todos estos cambios supone un replanteamiento del derecho que “nos defienda” ante el avance tecnológico. Y es precisamente en esta búsqueda de la seguridad la que acuña el término “neuroderecho”, asociado a la evolución de los dispositivos que inciden en las capacidades de las personas y por tanto del desenvolvimiento de su trabajo y en las nuevas relaciones laborales. No estamos lejos de los tiempos en los que la tecnología nos podrá leer la mente – las previsiones apuntan a la próxima década -, de hecho, EEUU ya cuenta con una red de laboratorios centrados en mapear el cerebro y eso hace que los gobiernos de todo el mundo se comiencen a plantear las modificaciones normativas que deberán cubrir estas circunstancias. En Estados Unidos, este movimiento comenzó con el proyecto BRAIN, impulsado por la Administración del expresidente de Estados Unidos, Barack Obama y con la creación de la citada red. Ahí se dieron cuenta de que mientrasya existen códigos éticos para el sector médico, no se han desarrollado unas, más que necesarias, guías que apliquen a la neurotecnología. No podemos quedarnos impasibles sabiendo que si Elon Musk ha conseguido que un mono con un implante cerebral de Neuralink (una de sus empresas) en el cerebro sea capaz de adelantarse a los movimientos de su oponente en un videojuego sencillo – el Pong-, el control de nuestras mentes en las relaciones laborales está en uno de los escalones de la evolución.

3.Es difícil definir el concepto de los neuroderechos. Forman parte de la nueva corriente llamada derechos de cuarta generación y se configuran como aquellos derechos que afectan a bienes jurídicos afectados por la genética o la bioingeniería y deben de garantizar un desarrollo legal y ético de estas investigaciones incluso, diría yo, de su aplicación práctica con el fin de salvaguardar a las personas en una de sus posesiones más preciadas, el cerebro. Si Musk afirma que las personas en unos 5 o 10 años seremos capaces de comunicarnos sin hablarnos usando los idiomas tradicionales para comunicarnos a través de un lenguaje único y universal a través de un chip, no es descabellado comenzar a pensar en las consecuencias que en las relaciones de trabajo tendrán estos avances y en la protección de los nuevos derechos de los trabajadores.

Pero lo que promueven los científicos desde que se puso en marcha el proyecto Brain es que los avances en la inteligencia artificial no vulneren los derechos de las personas.

4.Los brotes de la regulación. Un grupo de neurocientíficos de la universidad de Columbia con un español como impulsor, Rafael Yuste, ya han comenzado a alertar sobre los peligros de este tipo de tecnologías e conminan a los gobiernos de todo el mundo a comenzar a sentar las bases de una normativa específica que reconozca y proteja estos nuevos derechos, en línea con la Declaración Universal de los Derechos Humanos de 1948. No cabe duda que teorizar acerca de una tecnología que aun no existe no es fácil pero las vías de desarrollo de la misma ya nos muestran un futuro más cierto que incierto. La tendencia que se propone es la identificación de cinco estándares que se sumaran en la Declaración universal, a saber:

- Derecho a una identidad personal

- Libre elección

- Privacidad mental

- Igualdad de acceso a la tecnología de aumento de capacidades mentales

- Protección frente a la discriminación algorítmica o al sesgo

Chile se ha reconocido como el país pionero en la inclusión de los neuroderechos, como nueva realidad, en su normativa y está a un paso de introducirlos en su Constitución, con el objetivo de proteger la identidad mental como un derecho no manipulable y así protegerlo de los avances de la inteligencia artificial y de la neurociencia. Pese al revuelo mediático y la aceptación inicial, también tiene sus detractores que consideran que la propuesta no incluye ningún derecho subjetivo. España ha empezado a reconocer esta necesidad de regulación en la Carta de Derechos Digitales, con la inclusión de un artículo específico. Evidentemente este es un documento sin fuerza de ley, pero ha supuesto un avance en la identificación de una saga de derechos que pueden verse amenazados en esta sociedad en construcción. Y como en construcción que está, se hace necesario avanzar en la protección de la identidad individual, la confidencialidad y la seguridad de los datos relativos a los procesos cerebrales de la persona o garantizar la autodeterminación individual, la soberanía y la libertad de decidir del individuo. Pero la definición de derechos debe de ser global para evitar la creación de paraíso neuronales.

5. Las nuevas fronteras también para el derecho del trabajo. A los efectos de nuestra disciplina solo consideramos trabajo a las acciones humanas, por tanto, el trabajo es inseparable de la condición humana porque está vinculado al esfuerzo por conquistar esa naturaleza que permita extraer todos los bienes y servicios necesarios para el bienestar. Si ya existen sistemas que pueden decodificar ciertos tipos de pensamientos está claro que se hace necesaria una regulación del derecho a la privacidad, a la intimidad y al libre pensamiento, al igual que ya si existe una regulación a través de códigos éticos en el ámbito médico, porque aunque se hace especial hincapié en el uso terapéutico de la neurociencia para el tratamiento de determinadas enfermedades como lesiones cerebrales, parálisis, pérdidas de audición, Párkinson, el Alzheimer, la depresión o daños en la médula espinal, las cuestiones no se quedan ahí. Si un mono puede jugar a un videojuego sencillo con la mente y eso augura el manejo de un automóvil con el pensamiento o aprender idiomas al instante, eso nos llevaría a poder competir con la inteligencia artificial. Y si ya estamos analizando las repercusiones que esta (la IA) tiene en el ámbito de las relaciones laborales, un procesador cerebral instalado en la persona, nos sitúa en un capítulo de Black Mirror o en la sociedad distópica de Matrix.

Una vez que tengamos accesos a los pensamientos y las emociones, se hace necesaria la creación de un espacio donde el pensamiento divergente y creativo forme parte de los derechos de libertad. Las regulaciones de la IA podrían empezar por las medidas de autoestructuracion y las autoimpuestas que consisten en las directrices que las empresas, individual y colectivamente, elaboran para regular su propia conducta y que no pongan en riesgo la noción de persona y el libre albedrío. Las regulaciones autoimpuestas por las compañías podrían llegar a convertirse en costumbre empresarial y ser jurídicamente vinculantes a pesar de no consagrarse legalmente, con una amplia aceptación por el mercado[1].

Corremos el riesgo de no poder preservar nuestra intimidad en el ámbito laboral si finalmente se puede acceder a nuestros pensamientos. Se hace necesario establecer una categoría de “neuroderechos del trabajo”. Es, por tanto, una cuestión de tiempo que esta tecnología llegue al mercado para grabar ideas y pensamientos que, si lo trasladamos del ámbito meramente civil al laboral, puede resultar especialmente conflictivo, sobre todo en los procesos de reclutamiento, selección, promoción, negociación… donde la accesibilidad a los pensamientos puede derivar en situaciones de discriminación si se da cierto control sobre el comportamiento. Lo que está en nuestra mente es solo nuestro y no debería de ser accesible por terceros.

[1] WISCHMEYER, T. y RADEMACHER, T. (2020), Regulating Artificial Inteligence, Springer.